大容量の動画像データをリアルタイムに補正する

画像処理ハードウェアIPの設計と実装

情報科学研究科 メディアネットワーク専攻

情報通信システム学講座 情報通信ネットワーク研究室・准教授

博士(情報学)筒井 弘

プロフィール

2000年、京都大学工学部電気電子工学科卒。2005年、同大学院情報学研究科通信情報システム専攻 博士後期課程 修了(博士/情報学)。同年、京都大学大学院情報学研究科 特任助手。2007年、大阪大学大学院情報科学研究科 特任助教。2010年、京都大学大学院情報学研究科 助教。2013年より北海道大学大学院情報科学研究科情報通信ネットワーク研究室 准教授。

フルハイビジョンのデータをリアルタイムに処理

画像処理ハードウェアIPとはどのようなものですか。

筒井 近年、デジタルテレビに代表されるフルハイビジョン対応のデジタル機器が広く普及しています。その背景には半導体微細化技術の発展があるのですが、Full HD動画像の場合、解像度は1,920×1,080画素(2.1Mpixel)、1秒あたりのフレーム(画像)数は60枚、1画素あたりのビット数は24ビット(3,000Mbps)で地上デジタル放送のビットレート(最大16.85 Mbps)と比較しても非常に大きなデータ量になります。

膨大な量の動画像データの各種処理をリアルタイムに行うには、ソフトウェアではなくハードウェアで実現することが多く、その場合データをどのように一時的に保持し、どのように滞りなく処理するかがカギとなります。実装するハードウェアにはIP(IPコア)を組み込んだLSIやFPGAが広く使われます。IPとはSemiconductor Intellectual Property Coreのことで元々は知的財産という意味ですが、情報通信の世界ではLSIを構成する際に利用される再利用可能な機能ブロックを差し、System-on-a-chip (SoC)を実装するために広く利用されています。代表的なものに携帯音楽プレイヤーや携帯ゲーム機、スマートフォンなどに広く用いられているARMプロセッサがあります。私の研究では、画像処理ハードウェアIPの設計とFPGAへの実装に関する研究開発を進めています。本研究の特長はアルゴリズムとハードウェアの両方を見ながら開発している点で、産業界への応用展開を視野に入れた高速・高品質・低電力を実現するハードウェアの開発・実装を目指しています。

人間の視覚を模した画像を実現する適応的階調補正

具体的にはどのような技術が使われているのですか。

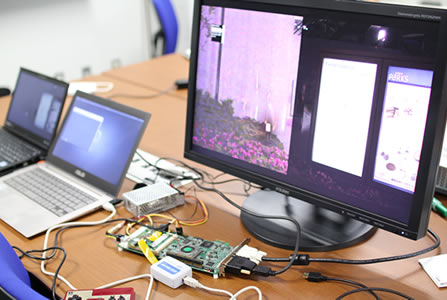

筒井 主に開発しているのは、Full HD動画像の自動補正に関する技術です。最近のデジタルカメラやスマートフォン搭載カメラなどには逆光でも露出を補正する機能がありますが、私の研究はそれと同じようなことをFull HDの動画像でリアルタイムに行うものです。図1(図1)を見てみましょう。一番左の入力画像(S)は、空が明るく、手前の建物と路面は暗くなっています。これは照明光(L/推定環境光)と反射率(R/色恒常性)がかけ合わさったものだと推定し、入力画像から照明光(L)を抜く(=反射率(R)の成分を抽出する)ことで人間の視覚と同じような見え方に補正するという考え方です。これを「適応的階調補正」と呼んでいます。(解説1)。

適応的階調補正により入力画像の補正手法は確立できましたが、これをFull HD動画像でリアルタイムに行うには、大量のデータを高速で処理する技術が必要です。元の解像度をそのまま使ったのでは処理が間に合わないので、いったん低解像度で処理し、最終的に元の解像度に拡大するという方法を考案しました。

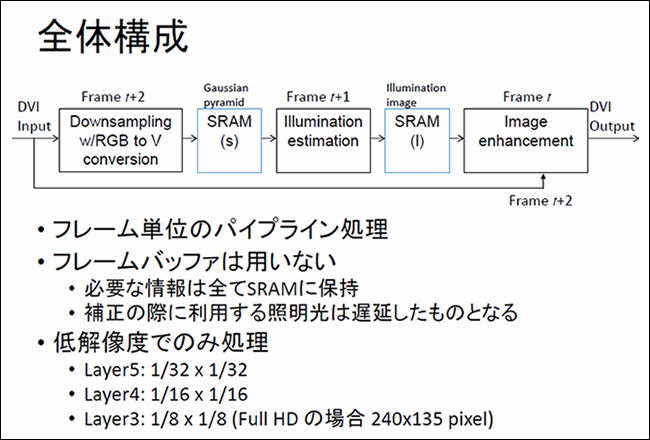

図2で説明しましょう(図2)。元の解像度のフレーム1枚を8分の一に圧縮し、SRAM(S)に一時保持しておきます。次に圧縮したデータの照明光推定(繰り返し処理)を行い照明光を算出。その結果をSRAM(I)に保持します。最後にSRAM(I)の結果を元解像度のフレームに適用して補正処理するのですが、元解像度のフレームはSRAM(S)、SRAM(I)に使われた2枚のフレームの後に来るものを使います。つまり、最終的な補正画像には2フレーム前の処理結果を用いることになるのです。(動画1/解説2)

2フレーム前の処理結果といっても1フレーム60分の1秒という短さのためほとんど違和感はありません。しかし、人や車が動いていたり画面が移動している場合は画像のズレが若干生じます。元解像度のデータを2フレーム分バッファリングして処理結果と同期させることも可能なのですが、メモリを大量に使用することなどから実用的とは言えず、今回の提案では採用しませんでした。

画像処理分野で幅広い応用が可能

大学発ベンチャーで製品化も実現

これらの技術はどのような分野で活用されているのでしょうか。

筒井 本研究の利点は、実装の際に各種設計パラメータが変更でき、用途や必要とされるクオリティに合わせてメモリ使用量や計算時間の増減が可能な点です。製品化する場合も、IPそのものからIPを組み込んだチップ、FPGAなど多様な形態で提供でき、応用の範囲は幅広いと考えられます。

現在、大阪大学や京都大学などの研究室が中心となって設立した大学発ベンチャーの株式会社シンセシスに産学連携研究室として参画しており、本研究成果もHDR(明るさバランス自動補正)IPで製品化されています。これは、前職から関わっているものなのですが、今後さらに、画像処理や加工などの技術開発で産業界に貢献していきたいと思います。

解説

解説1:適応的階調補正

画像内の情報を利用して補正係数を画素ごとに決定し、暗い部分だけを明るく補正する。さらに明るい部分の周囲を若干暗くすることで、人間が本来知覚すべき画像に近づけている。人間の視覚の色恒常性をモデル化したRetinex理論をベースに、照明光の推定にはKimmelの理論を採用。

解説2:フレーム単位のパイプライン処理

アルゴリズムは①入力およびガウシアンピラミッド生成部、②照明光推定部、③補正処理および出力部に分けられ、これら3つはフレーム単位としてパイプライン動作する。3つのパイプラインステージでそれぞれ異なるフレームを処理し、①のデータはSRAM(S)、②の照明光推定で繰り返し処理したデータはSRAM(I)に保持。最後の補正処理部では、SRAM(S)SRAM(I)の次(2フレーム後)の元解像度データを用いる。