日常生活場面における人間とロボットの「共生」を目指して

情報科学研究科 複合情報学専攻

複雑系工学講座 混沌系工学研究室・教授

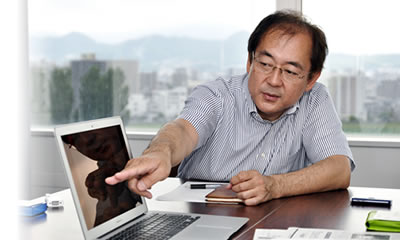

博士(情報科学)小野 哲雄

プロフィール

1997年北陸先端科学技術大学院大学(JAIST)博士後期課程を修了。1997年〜2001年、ATR知能映像通信研究所客員研究員。公立はこだて未来大学の助教授(2001年~2005年)、教授(2005年~2009年)を経て、2009年10月北海道大学情報科学研究科に着任。ヒューマンエージェントインタラクション、ヒューマンロボットインタラクション、インタラクティブシステムに関する研究に従事。情報処理学会、電子情報通信学会、ヒューマンインタフェース学会、ロボット学会、ACM各会委員。

人間とロボットの共生を目指すインタラクションの研究

ロボット開発には幅広い研究領域がありますが、先生の研究テーマはどのようなものですか。

小野 ロボットの研究開発はハードウェア・ソフトウェア両面からのアプローチがあります。ヒューマノイドロボットの分野では、ハードに関してはすでに一段落した感があり、ホンダのアシモに代表される二足歩行ロボットや、演劇をするアンドロイドなどが、かなり人間に近い動きをするようになっています。しかし、ロボットに搭載するソフトウェア(AI:人工知能)はまだまだ未熟で、環境や対象物を認知して的確に対応したり、人間と円滑にコミュニケーションできていないのが現状です。

人工知能の分野で今注目されているのが、インタラクション(相互作用)の研究です。コミュニケーションと言ってもいいのですが、人間同士の複雑で高度なコミュニケーションより低いレベルのやり取りという意味でインタラクションと呼んでいます。ヒューマンロボットインタラクション(HRI)や、ヒューマンエージェントインタラクション(HAI)などがあり、国際会議も行われるほどポピュラーになりつつあります。

アニメや映画のように、ヒューマノイドロボットが人間に交じって街中を歩くようになるには、人とロボットが円滑にコミュニケーションでき、状況に応じて自律的に行動することが必要です。その前段階として、最低限のインタラクションを実現することが私たちの研究テーマです。ロボットが人間社会に溶け込むことを目指した文部科学省の新学術領域『人とロボットの共生による協創社会の創成』というプロジェクトにも参画しています。

エージェントがメディアを移動しながらユーザをサポート

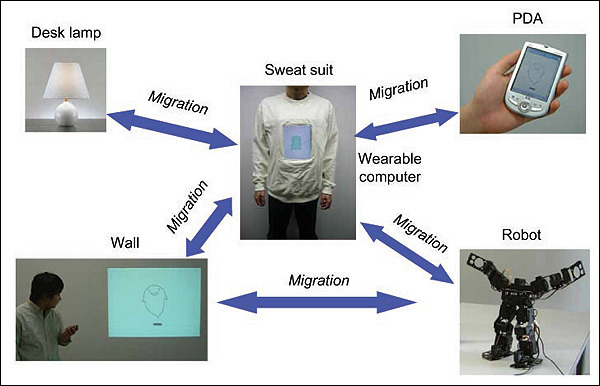

小野 パソコンや携帯端末などには、ユーザをサポートするための秘書的な機能を持ったアプリが搭載されています。ドコモの「しゃべってコンシェル」やiPhoneの「Siri」などです。これらに自律的な機能を持たせたものをエージェントと呼びます。本研究室では、エージェントがパソコンや携帯端末の中だけでなく、他のメディアにも移動しながらユーザの日常生活をサポートする「ITACO(イタコ)システム」を開発しました(解説1)。InTegrated Agents for COmmunicationの略ですが、ひとつのエージェントがさまざまなメディアに乗り移ることから、恐山のイタコにもかけています。(笑)

エージェントはロボットと違って実世界で動くことはできません。その代わりいろいろな端末に乗り移り、ユーザの近くでサポートします。本研究ではかわいらしいキャラクターに扮したエージェントがPCからウェアラブルコンピュータに移動して一緒に外出したり、テーブルランプに乗り移って明るさを調節したり、ロボットに乗り移って遊んだりします。ポイントは、会話や行動履歴からユーザの好みや行動の傾向を記憶し、それらの個人情報をもとに各ユーザに特化したさまざまな支援を行うことです。自分のことをよく知っていて、命令しなくても状況を判断して必要なことをやってくれる存在なのです。今はまだ乗り移る場所やできることが限られていますが、ユビキタス環境が発展すれば冷蔵庫などの家電製品やカーナビなどへも広がり、屋内外を問わず行動を共にできるようになると思います。

会話や表情を感知し、空気を読むロボット

ロボット分野ではどのような研究がありますか。

小野 「空気を読むロボット」というのがあります(解説2)。私たちはコミュニケーションにおいて常に空気を読んでいます。例えば、友だちを見かけたとき、その人が誰かと熱心に話をしていたら、いきなり割り込むことはしませんよね。会話が途切れるタイミングを待ったり、その場では声をかけなかったりします。それと同じことをロボットにさせようというものです。人間の対話の活性度を感知する機能をロボットに実装し、発話量や発言の重なりで活性度を測り、高いときは「会話が弾んでいるから邪魔しないようにしよう」と判断します。

実社会では、二人とも黙っているから活性度が低いとは限りません。深く考え込んでいるのかもしれないからです。逆に口論をしているような時には割って入った方がいい場合もある。現段階ではロボットにそこまで人間心理を読み取ることはできません。そもそも人間の脳の仕組みや思考・行動のメカニズムも完全には解明されておらず、人間のように考え行動するロボットを作ることは、人間そのものを探究することにつながります。そこには情報科学だけでなく脳科学や認知科学、学習科学など多様な分野の融合が必要です。

これまでの人工知能研究は一般的な賢さを追求してきました。人間と同じような賢さです。しかし、人間の脳と同じレベルの人工知能を作るにはまだまだ時間がかかるのではないでしょうか? ではどうするか? 私たちは、今使えそうな技術は、用途を絞る形で社会に埋め込んでいくというアプローチを考えています。完璧ではないけれど人間社会に参加させ、実際に使うことで課題や問題点を発見し、少しずつ精度を高めていく。先述のSiriも音声認識のレベルやコミュニケーションの点では至らない部分も多いのですが、情報検索という限られた用途では使えます。お掃除ロボットのルンバも同様です。時には不具合も起こしますが、部屋をきれいにするという点では十分役立っている。これは、エージェントやロボットが実社会に溶け込んでいる実例といえるでしょう。人間だって完璧に空気が読めるわけでないし、失敗からインスピレーションを得ることもあります。ロボットにも少しぐらい不適合があってもいいのではないでしょうか。完全無欠のロボットが一方的に人間を支援するのではなく、互いに補完し合い、時には人間の創造性を刺激する。そんな関係を築くことが本当の共生ではないかと思います。

解説

解説1:ITACOシステム

タブレットPC上に存在するエージェントが、センサによる生体信号や過去の行動履歴からユーザの趣味や行動傾向を読み取り、それをもとにウェアラブルPC、PDA、壁掛けディスプレイ、テーブルランプ、オモチャのロボットなどのメディア間を移動しながら状況に応じて道案内や照明の調節、遊び相手などをする。実験では、ユーザがエージェントに対しどのような感情を抱くかという検証も行い、ユーザはエージェントがメディア間を移動しても同じ人格を持つと認識し、愛着を感じるという結果も得られた。

人と共生するエージェントやロボットslideshow(動画を再生)

解説2:空気を読むロボット

ユーザが携帯しているスマートフォンとセンシング技術、音声の認識技術などを用いて、二人の人間の距離や身体の向き、会話の活性度などを検知し「会話が弾んでいるかどうか」を判断する。ロボットには赤外線モーションセンサやマイクを搭載し、発話量や発話の重なりから活性度を計測。会話が弾んでいると判断した場合は、二人の間を通らないよう進路を変える。

ロボビーが対話空間に侵入 or 対話空間を回避slideshow(動画を再生)

ロボビーが対話中に介入 or 活性度が下がったら介入slideshow(動画を再生)

人-人のAugmented Social Spaceslideshow(動画を再生)